導入文

AIの進化が加速する一方で、その倫理的な側面、特にAIが学習データから無意識に取り込んでしまう「バイアス(偏り)」の問題は、社会的な課題となっています。ソニーグループのAI研究開発部門は、この重要な課題に取り組むため、AIが人間の画像を分析した結果に偏りがないかを評価するための新たなデータセット「Fair Human-Centric Image Benchmark (FHIBE, フィービー)」を開発しました。本稿では、ソニーGが開発したこの画期的なデータセットの詳細と、AI倫理の確立に向けたその意義について深掘りします。

要約本文(約1000字)

AIバイアス問題の深刻化と倫理観測の必要性

AIが社会の様々な場面で意思決定に関わるようになるにつれて、その判断の根拠となるデータに含まれるバイアスが、差別や不公平な結果を生み出すリスクが指摘されています。特に、顔認識や画像分析といった人間を対象とするAIシステムにおいて、特定の属性(人種、性別、年齢など)に対する偏りが生じると、社会的な信頼を大きく損なうことになります。

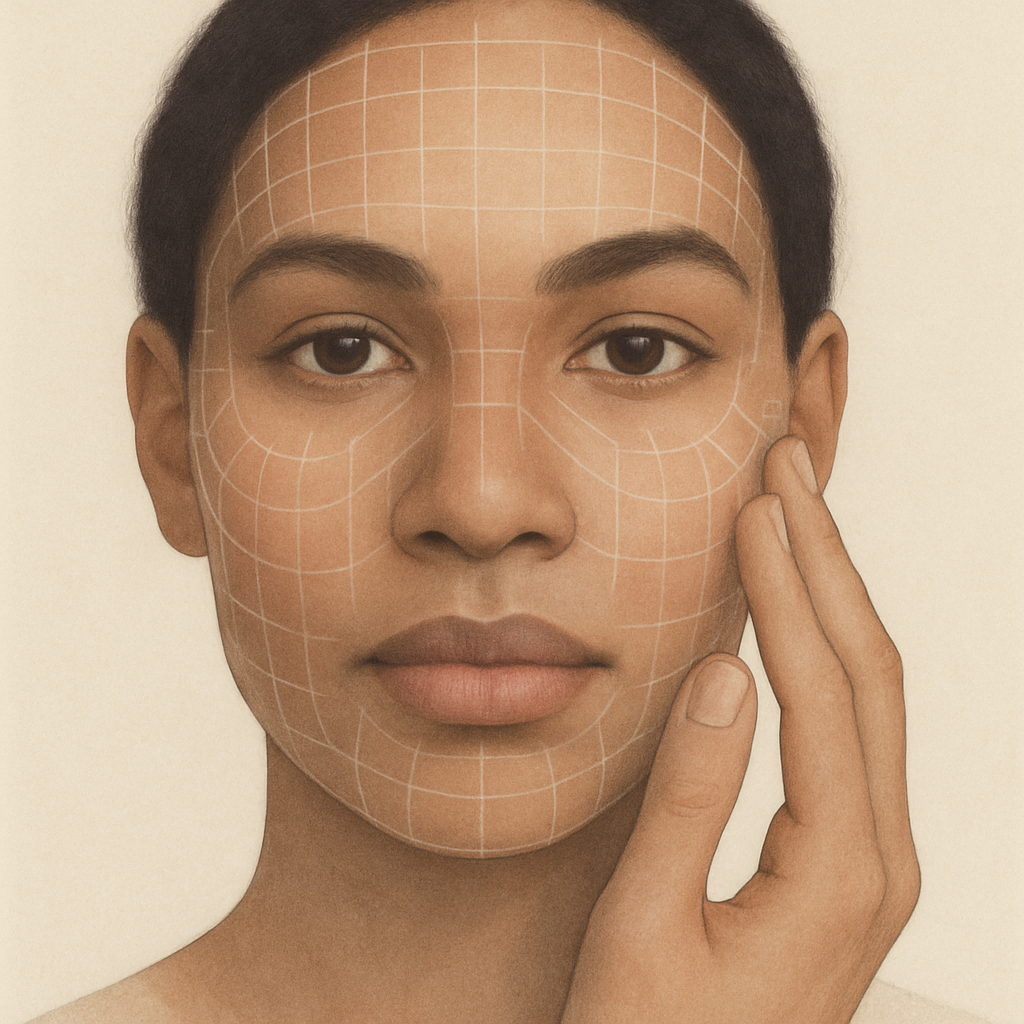

ソニーグループのAI研究開発部門は、この問題に対処するため、AIが人間の画像を分析した結果にバイアスがないかを評価するためのデータセット「Fair Human-Centric Image Benchmark (FHIBE, フィービー)」を開発しました。これは、AIの倫理的な側面を科学的に「観測」し、定量的に評価するための重要な一歩となります。

FHIBE(フィービー)データセットの革新性

FHIBEは、AIが人間の画像を分析する際に生じるバイアスを、多角的に評価できるように設計されています。従来のデータセットが特定のバイアスに焦点を当てていたのに対し、FHIBEはより包括的な観点から、AIの倫理的な振る舞いを検証することを可能にします。

このデータセットの核となるのは、多様な属性を持つ人間の画像と、それに対するAIの分析結果を比較するための厳密な評価基準です。ソニーGは、このデータセットを用いて、AIが特定の集団に対して不当に低い精度や異なる判断を下していないかを検証します。これにより、開発者はAIモデルのトレーニング段階でバイアスを特定し、修正するための具体的な手がかりを得ることができます。

FHIBEの導入は、AI開発プロセスにおける倫理的な配慮を、抽象的な議論から具体的な技術的検証へと移行させることを意味します。AIの「公平性(Fairness)」を担保するための、実用的なベンチマークとして機能することが期待されています。

AI倫理の国際標準化への貢献

ソニーGのこの取り組みは、単に一企業の技術開発に留まらず、AI倫理の国際的な標準化に向けた重要な貢献となります。AIの倫理的な問題は国境を越えた課題であり、FHIBEのような客観的な評価ツールは、世界中の研究者や開発者が共通の基準でAIの公平性を議論し、改善していくための基盤を提供します。

AIが真に社会に受け入れられ、信頼される技術となるためには、その「知性」だけでなく、「倫理観」が不可欠です。ソニーGのFHIBEは、AIの倫理観を科学的に検証し、より公平で信頼性の高いAIシステムの実現に向けた、大きな一歩となるでしょう。